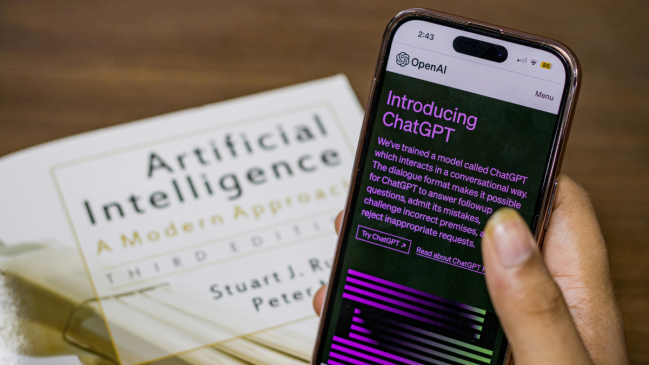

Internet enfrenta una creciente ola de fraudes y estafas impulsadas por inteligencia artificial, con imágenes, audios y videos falsos cada vez más difíciles de distinguir de la realidad, que generan ya millonarias pérdidas para empresas y personas.

Los contenidos manipulados o creados con IA provocaron el último año perjuicios superiores a los 1.500 millones de dólares (alrededor de un billón y medio de pesos chilenos), según diversos informes.

Entre los engaños más frecuentes se encuentran las facturas falsas para reembolsos corporativos, fotografías alteradas para justificar seguros o devoluciones, imágenes de hechos que nunca ocurrieron y audios clonados para ordenar transferencias de dinero.

Ante este escenario, gobiernos y empresas tecnológicas impulsan herramientas para detectar imágenes falsas. Plataformas como Vericta, IMGDetector.ai, RealReveal, Tenorshare o AI or Not analizan inconsistencias y rastros técnicos de contenido generado con IA.

Vericta —impulsada con apoyo de organismos públicos como el Centro para el Desarrollo Tecnológico e Industrial y la Municipalidad de Barcelona— desarrolló tecnología capaz de determinar en segundos si un archivo es real o fue generado con IA.

Para Georgina Viaplana, cofundadora y directora de la empresa, el problema trasciende lo tecnológico y responde también a un factor cultural: "Precisamente porque una imagen tiene tanto poder, vale la pena manipularla"; sería el razonamiento de los estafadores.

La ejecutiva sostiene que la verificación de contenidos será clave en sectores donde una imagen puede traducirse en pérdidas económicas directas, como seguros, comercio electrónico, logística o mercado inmobiliario, donde fotografías alteradas se usan para exigir compensaciones o validar operaciones.

La tecnología avanza, pero el engaño también

Desde la industria de ciberseguridad advierten que la detección no será infalible. "Es una carrera armamentística digital: cada mejora en detección provoca una mejora en generación", explicó Hervé Lambert, responsable global de consumo en Panda Security.

Lambert considera que estas herramientas serán útiles en entornos profesionales —medios de comunicación, tribunales o policías—, pero duda de su adopción masiva entre usuarios comunes, donde la verificación de contenidos aún no es una práctica extendida.

"La mayoría de las personas no contrasta ni una noticia, menos aún una imagen que encaja con su narrativa", señaló, advirtiendo que la baja cultura de ciberseguridad facilita el éxito de estafas con contenido manipulado.

Educación digital y control: claves para frenar el fraude

Expertos coinciden en que etiquetar desde el origen los contenidos generados con IA podría ayudar a frenar los engaños, pero advierten que las marcas de agua y metadatos también pueden modificarse, y que internet carece de fronteras regulatorias claras.

Por ello, plantean tres ejes para enfrentar el problema: regulación, responsabilidad de las plataformas digitales y alfabetización tecnológica de la población.

Aun así, subrayan que ninguna herramienta será suficiente por sí sola.